Что такое Uni-1

Uni-1 – нейросеть для генерации изображений от Luma Labs, которая работает принципиально иначе, чем её предшественники. Главное её отличие – одновременное понимание запроса и создание изображения, а не последовательное выполнение этих операций. Это значит, что нейросеть сначала анализирует, что вы хотите, затем планирует композицию и только после этого генерирует картинку.

Архитектура Uni-1 основана на авторегрессионном трансформере – модели, создающей содержимое токен за токеном. Проще говоря, она обрабатывает текст и изображения как единый поток, что позволяет лучше улавливать связи между объектами и исполнять сложные инструкции.

Uni-1 обучена на 200 миллионах пар изображений и описаний. Это дало модели глубокое понимание не только внешнего вида объектов, но и их назначения. Например, запрос «уютный диван» приводит к созданию действительно комфортного места для отдыха, а не просто случайного предмета мебели.

Особенность модели – встроенное «рассуждение» перед генерацией. Uni-1 анализирует пространственные отношения между объектами, логику сцены и даже временные последовательности. При создании сложной композиции из нескольких референсов модель объединяет их в цельное, физически правдоподобное изображение.

Компания Luma Labs утверждает, что такой подход существенно улучшает качество результата. В слепых тестах Uni-1 заняла первое место по показателю Elo в категориях «Общее качество», «Стиль и редактирование» и «Работа с референсами».

Ключевые возможности Uni-1

Генерация изображений с глубоким пониманием контекста

Uni-1 не просто создаёт картинки по описанию – она интерпретирует намерения пользователя. Нейросеть разбирает инструкцию на части, учитывает логику сцены и пространственные отношения ещё до начала генерации. Благодаря этому сложные запросы с множеством условий модель обрабатывает точнее, чем традиционные генераторы.

Например, при запросе «создай сцену из фильма нуар с детективом в плаще, стоящим под дождём, с городским горизонтом на заднем плане» Uni-1 правильно взаимодействует со светом, тенью, композицией и перспективой, создавая логичную и атмосферную картину.

Кроме того, модель учитывает национальные особенности культур, поп-культуру, физические законы, географию и архитектуру. Запрос «традиционный японский храм в горах» приводит к изображению с характерными архитектурными чертами и гармонией с природой.

Результаты Uni-1 чаще выглядят связно и логично, пользователи отмечают, что модель реже создаёт визуальные ошибки: невозможные перспективы, некорректное освещение или несогласованные масштабы.

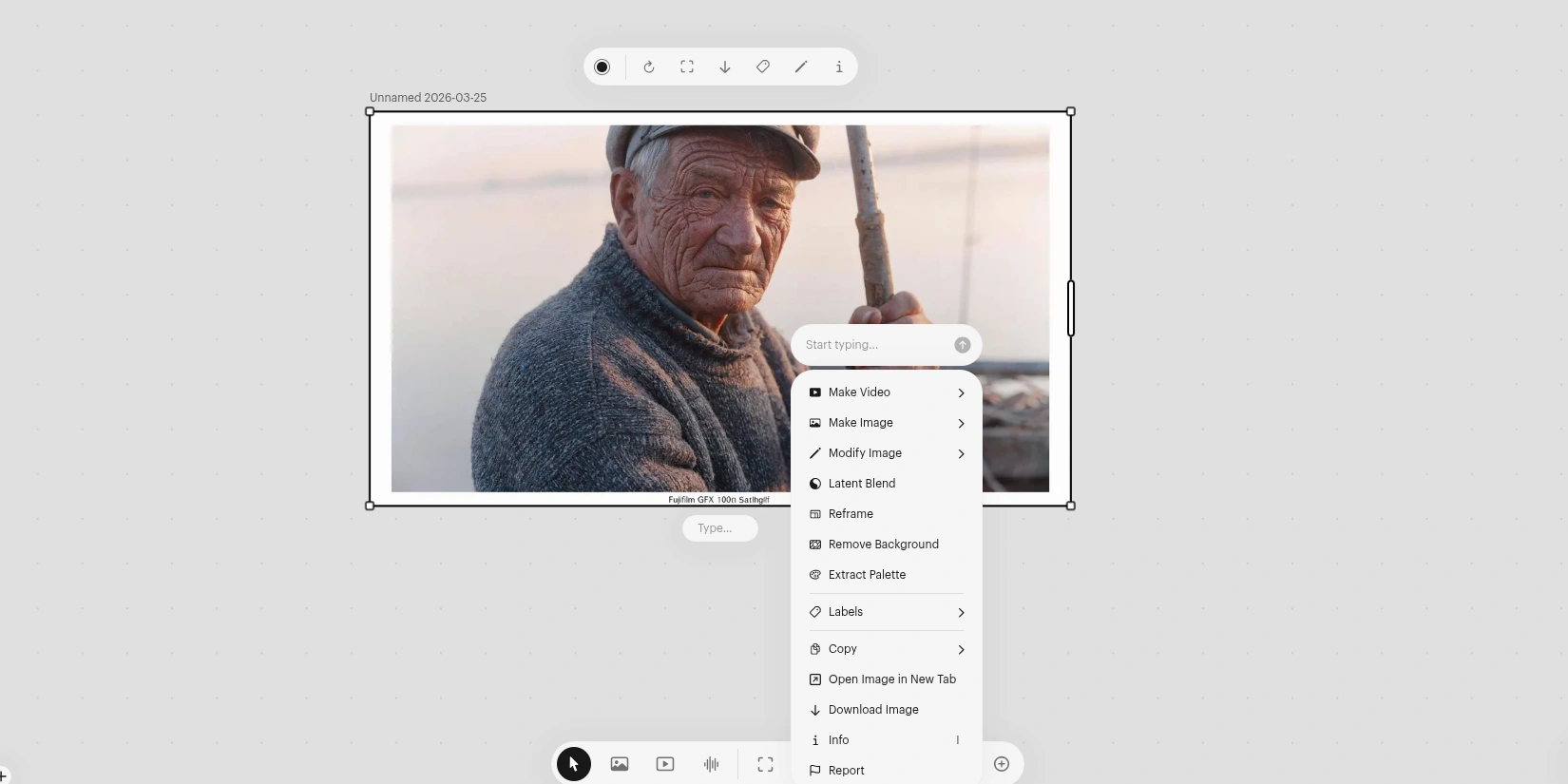

Редактирование с сохранением контекста

Uni-1 позволяет уточнять и дорабатывать изображения в ходе диалога, сохраняя контекст предыдущих запросов. Вам не нужно каждый раз полностью описывать сцену: модель помнит уже созданное и вносит изменения с учётом этого.

Например, создав портрет, вы можете написать «сделай волосы длиннее и рыжими». Uni-1 поймёт, о каких волосах идёт речь, и изменит их, не искажая остальные детали.

При редактировании модель корректирует освещение, перспективу и взаимодействие объектов. Если вы переместите предмет, Uni-1 пересчитает тени и отражения для новой позиции.

Такой подход особенно полезен для сложных сцен, где традиционные генераторы ошибаются. Вместо множества вариантов с нуля вы итеративно улучшаете один результат, сохраняя качество и контекст.

Работа с референсами и трансформация стилей

Uni-1 умеет объединять разные фотографии или эскизы в одну композицию. Это открывает широкие возможности для создателей контента, которым нужно сочетать элементы из разных источников.

Модель переносит лица, позы и композиции из референсных фотографий в новые изображения. Например, загружая фото человека, вы получите нарисованного персонажа с его чертами и выражением.

Кроме того, Uni-1 преобразует изображения более чем в 76 художественных стилей. Вы можете взять обычную фотографию и получить её в стиле импрессионизма, комикса, цифровой живописи и других направлений. Качество стилизации часто превосходит конкурентов благодаря глубокому пониманию композиции и деталей.

Пример: сфотографировав офис, вы можете заказать его в стиле киберпанка с неоновой подсветкой и футуристическими элементами. Uni-1 не просто сменит цвет, она подстроит мебель, освещение и атмосферу под стиль.

Создание раскадровок и видеоматериалов

Uni-1 помогает создавать раскадровки с сохранением персонажей и стиля между кадрами. Это удобно для сценаристов, режиссёров и художников, которые хотят быстро визуализировать идею фильма или анимации.

Вы описываете сцену, модель генерирует первый кадр, а затем озвучиваете развитие сюжета. Uni-1 создаёт следующий кадр, сохраняя внешний вид персонажей, освещение и стиль. Такой метод гораздо быстрее, чем рисовать каждый кадр вручную или обучать модель заново.

Такой инструмент полезен не только профи. Контент-мейкеры на YouTube, художники и авторы комиксов могут использовать его для быстрого оформления идей.

Визуальное понимание и распознавание объектов

Разработчики Luma Labs сообщают, что обучение модели на генерацию одновременно улучшает способность понимать уже существующие изображения. Uni-1 не просто рисует – она хорошо разбирается в содержании картинок.

В задачах распознавания объектов модель почти догоняет Gemini 3 Pro от Google. Она показывает превосходство в бенчмарке RISEBench, оценивающем визуальное редактирование с элементами логики. Uni-1 отлично понимает пространство, время и причинно-следственные связи – области, где ИИ традиционно слабее.

Это открывает новые сценарии: анализ изображений, поиск объектов по описанию, понимание композиции и автоматическое предложение улучшений.

Условия использования UNI-1

Uni-1 доступна на платформе Luma Labs. Сервис предлагает бесплатные кредиты для проб и платные планы для индивидуальных и корпоративных пользователей.

Стоимость генерации – в районе 0,09 доллара за изображение в разрешении 2K (примерно 8–9 рублей). Это делает сервис доступнее многих конкурентов.

| Стоимость | |

|---|---|

| Text to Image | $0.0909 |

| Image to Image | $0.0933 |

| Multi-ref, 1 img | $0.0933 |

| Multi-ref, 2 img | $0.0957 |

| Multi-ref, 8 img | $0.1101 |

Точную структуру тарифов и размер бесплатных кредитов рекомендуется уточнять на официальном сайте Luma Labs.

Часто задаваемые вопросы

Что такое Uni-1?

Uni-1 – мультимодальная модель ИИ от Luma Labs для генерации изображений, которая сочетает понимание запроса и создание изображения в едином процессе на основе авторегрессионного трансформера. Она анализирует текст и изображения как единый поток, проводит "рассуждение" перед генерацией, учитывая контекст, пространственные отношения и логику сцены.

Какие ключевые возможности Uni-1?

Uni-1 поддерживает генерацию изображений с глубоким пониманием контекста, итеративное редактирование с сохранением контекста, работу с до 9 референсами, трансформацию в 76+ художественных стилей, создание раскадровок и визуальное распознавание объектов. Модель лидирует в тестах по качеству, стилю и редактированию.

Поддерживает ли Uni-1 русский язык?

Да, Uni-1 поддерживает несколько языков, включая русский, английский и испанский. Пользователи могут писать запросы на русском, и модель одинаково хорошо их понимает.

Сколько стоит использование Uni-1?

Стоимость генерации одного изображения в разрешении 2K составляет около 0,09 USD (примерно 8–9 рублей). Доступны бесплатные кредиты для проб, платные планы и корпоративные опции; точные тарифы уточняйте на сайте Luma Labs.

Как Uni-1 работает с референсами и редактированием?

Uni-1 позволяет загружать до 9 референсных изображений для создания композиций, переносит лица, позы и стили. Редактирование происходит в диалоге с сохранением контекста: модель корректирует изменения, пересчитывая освещение и перспективу, без необходимости повторять полное описание.

Какие недостатки у Uni-1?

Uni-1 относительно новая (вышла в марте 2026), имеет ограниченное количество независимых тестов, неясности со скоростью и масштабируемостью, а также ограниченную информацию об API и интеграциях в рабочие процессы.

Где доступен Uni-1 и как начать?

Uni-1 доступна на платформе Luma Labs через веб-интерфейс с бесплатными кредитами для теста. API ожидается скоро; присоединяйтесь к waitlist для раннего доступа.